국립금오공과대학교 학부생 제1저자 논문, 컴퓨터 과학 분야 최고 권위 학회서 채택

김영원 교수(교신저자) / 김정현 학생(제1저자) / 이제민 학생(제2저자)

국립금오공과대 김정현 학생, XR 협업용 멀티모달 상호작용 전략으로 IEEE ISMAR 2025 논문 채택”

[한국유통신문= 김도형 기자] 국립금오공과대학교(총장 김혁근) 컴퓨터공학부 소프트웨어전공 4학년 김정현 학생(지도교수 김영원)이 제1저자로 참여한 논문이 컴퓨터 과학 분야의 최고 권위 학회 중 하나인 ‘IEEE ISMAR 2025(International Symposium on Mixed and Augmented Reality)’ 정규 논문으로 채택됐다. 이 논문은 오는 10월 8일부터 12일까지 대전에서 열리는 국제학술대회에서 발표될 예정이다.

김정현 학생의 논문 제목은 ‘What Makes Object Referencing Clear? Multimodal Strategies for Shared Understanding in XR Collaboration’로, 협업 XR(확장현실) 환경에서 사용자 간 명확한 객체 지시를 위해 적절한 멀티모달 상호작용 전략을 제시했다. 본 연구는 시선(gaze), 지시 제스처(pointing), 음성(voice)을 통합한 상호작용 방식이 사용자의 의사소통 명확성과 효율성을 크게 향상시킨다는 점을 규명했다.

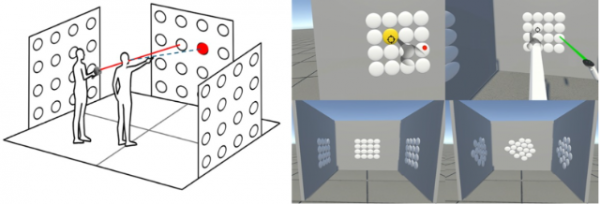

멀티모달 객체 지시 실험 환경 시각화

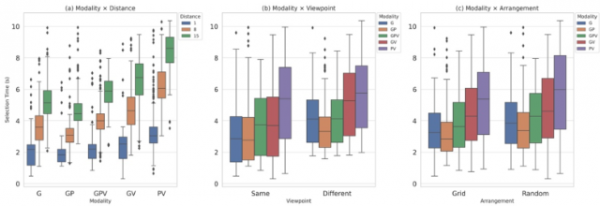

실험 조건별 상호작용 모달리티 성능 비교 그래프

특히 사용자 간 거리(1m, 8m, 15m), 시점 차이, 객체 배열 방식(정렬 및 랜덤) 등 현실적인 변수들을 고려해 다양한 상황에서 최적의 멀티모달 전략을 체계적으로 실험하고 분석한 점이 눈에 띈다. 연구 결과, 시선 기반 빠른 참조 기능과 공간적 명확성을 제공하는 지시 제스처, 의미 전달에 강점을 가진 음성의 조합이 가장 뛰어난 성능을 발휘하는 것으로 나타났다.

김정현 학생은 “이번 연구는 XR 협업 환경에서 기존 소통 한계를 극복할 수 있는 효과적 멀티모달 상호작용 전략을 제시했다”며, “앞으로 XR 및 메타버스 기반 협업이 보다 원활하고 실질적으로 이뤄지는 데 기여하길 바란다”고 말했다.

지도교수 김영원 교수는 “다양한 조건에서 실제 사용자들의 의사소통 방식을 정량적으로 분석하고 검증한 점에서 매우 중요한 연구”라며, “본 연구가 XR 협업 시스템 설계에 실질적 가이드라인을 제공해 다중 사용자 기반 가상 협업 환경에서 의사소통의 명확성과 효율성 확보에 핵심적인 역할을 할 것”이라고 평가했다.

이번 연구는 국립금오공과대학교 컴퓨터공학부 소프트웨어전공 확장현실 및 메타버스 연구실의 주도로 진행됐으며, 국립과학수사연구원 연구과제비 지원을 받았다.

<저작권자(c)한국유통신문. 무단전재-재배포 금지>

기사제보 및 사회적 공헌활동 홍보기사 문의: 010-3546-9865, flower_im@naver.co

검증된 모든 물건 판매 대행, 중소상공인들의 사업을 더욱 윤택하게 해주는

Comments